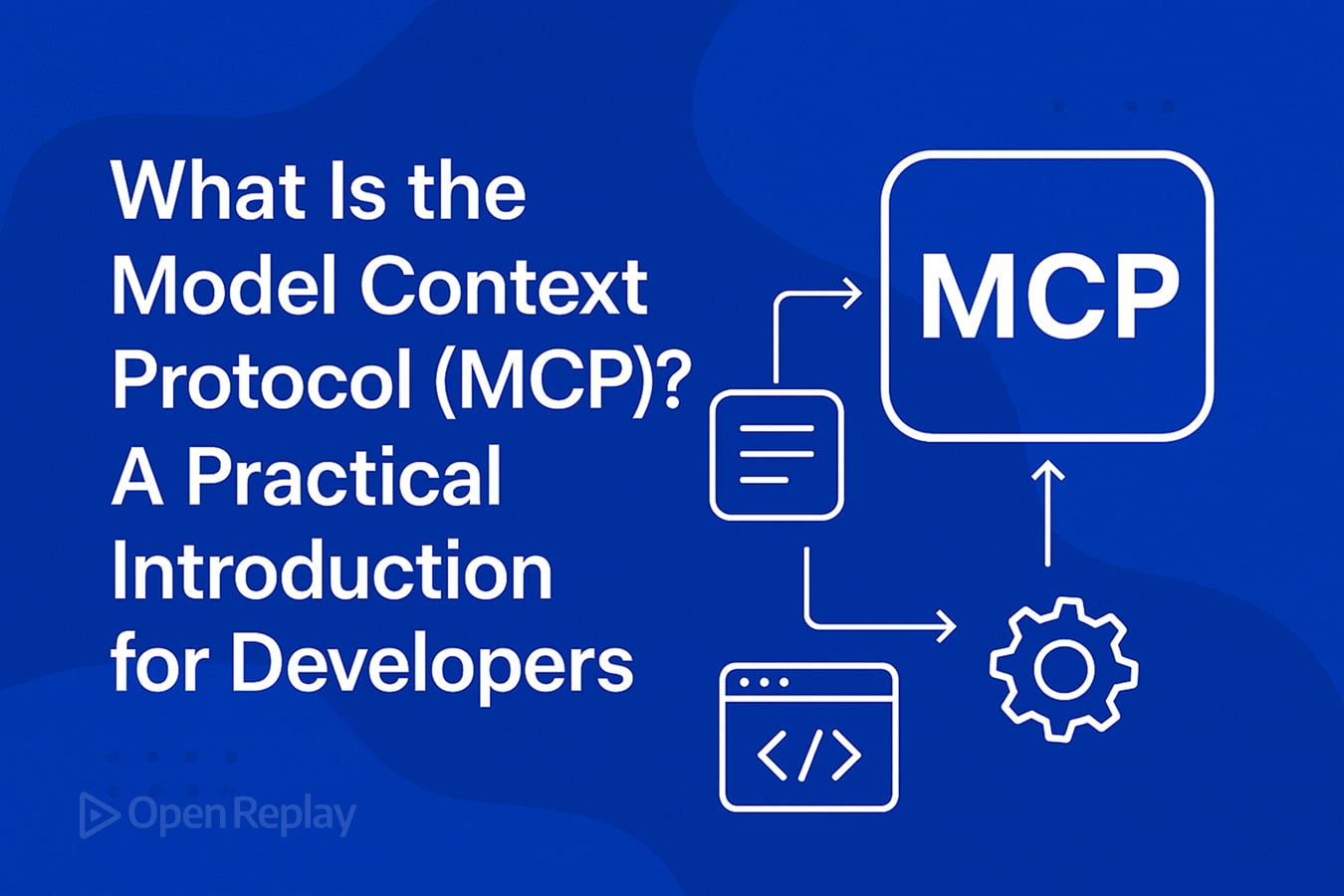

¿Qué es el Protocolo de Contexto de Modelo (MCP)? Una introducción práctica para desarrolladores

La integración de IA con herramientas externas siempre ha sido complicada. Cada conexión requería código personalizado, integraciones frágiles y un sinfín de casos excepcionales. El Protocolo de Contexto de Modelo (MCP, por sus siglas en inglés), introducido por Anthropic, cambia esto.

Este artículo explica qué es MCP, por qué es importante y cómo los desarrolladores pueden comenzar a utilizarlo.

Puntos clave

- MCP es un estándar abierto para conectar modelos de lenguaje de gran tamaño (LLMs) con herramientas y fuentes de datos.

- Simplifica las integraciones de IA reemplazando implementaciones individuales con un protocolo común.

- MCP ya está permitiendo aplicaciones de IA más capaces al estandarizar el acceso a bases de datos, APIs y archivos locales.

Por qué la IA necesitaba un estándar como MCP

Los primeros LLMs como GPT-3 solo podían predecir texto. No podían enviar correos electrónicos, buscar en bases de datos o desencadenar acciones en el mundo real. Los desarrolladores comenzaron a añadir herramientas a los modelos manualmente — un sistema frágil propenso a fallos cada vez que las APIs cambiaban.

La industria necesitaba una forma estándar para que los modelos interactuaran con sistemas externos. MCP resuelve esto, de manera similar a cómo REST estandarizó la comunicación API hace años.

Cómo funciona el Protocolo de Contexto de Modelo

MCP utiliza un modelo cliente-servidor con tres partes principales:

- Host: La aplicación de IA (como Claude Desktop) que permite conexiones externas.

- Cliente: El componente dentro del host que se comunica con servidores externos.

- Servidor: Un proceso separado que expone herramientas, datos o instrucciones al modelo de IA.

El servidor habla un lenguaje común (MCP) que el cliente entiende, sin importar a qué servicio o base de datos se conecte.

Los cinco componentes básicos de MCP

MCP estandariza la comunicación utilizando cinco primitivas:

Primitivas del servidor

- Prompts: Plantillas o instrucciones inyectadas en el contexto de la IA.

- Recursos: Datos externos, como entradas de bases de datos o archivos, que se introducen en la IA.

- Herramientas: Funciones ejecutables que la IA puede llamar, como “escribir un registro en la base de datos”.

Primitivas del cliente

- Root: Acceso seguro a archivos locales o estructuras de datos.

- Sampling: La capacidad de los servidores para solicitar ayuda a la IA cuando sea necesario, como generar una consulta de base de datos.

Este sistema bidireccional permite una interacción real — la IA puede tanto usar herramientas como ayudar a sistemas externos de manera inteligente.

Resolviendo la pesadilla de la integración

Antes de MCP, conectar n modelos diferentes a m herramientas diferentes requería n × m integraciones manuales.

Con MCP, cada herramienta solo necesita soportar un protocolo. Cada modelo solo necesita entender ese mismo protocolo. Esto reduce drásticamente la complejidad y hace posible conectar herramientas y modelos como piezas de Lego.

Ejemplo práctico: conectando Claude a una base de datos

Supongamos que quieres que Claude lea de tu base de datos Postgres.

- Inicias un servidor MCP que sabe cómo comunicarse con Postgres.

- Claude (a través de su cliente MCP) se conecta a ese servidor.

- Cuando le haces una pregunta a Claude, utiliza las primitivas MCP para obtener datos a través del servidor, de forma segura y correcta.

Sin scripts personalizados. Sin soluciones provisionales frágiles. Solo comunicación estandarizada.

Estado actual del ecosistema MCP

El ecosistema está creciendo rápidamente:

- Los SDK de MCP están disponibles para TypeScript, Python y otros lenguajes.

- Los desarrolladores ya han construido servidores MCP para GitHub, Slack, Google Drive y bases de datos como Postgres.

- Clientes como Cursor, Windsurf y Claude Desktop ya soportan conexiones MCP.

Se esperan aún más herramientas e integraciones en los próximos meses.

Desafíos técnicos a tener en cuenta

Aunque prometedor, MCP todavía enfrenta algunas fricciones:

- Configurar servidores localmente hoy implica descargas de archivos, ediciones manuales de configuración y ejecución de procesos en segundo plano.

- La documentación y la incorporación para configuraciones MCP podrían ser más fluidas.

- A medida que el protocolo evoluciona, las implementaciones tempranas pueden necesitar actualizaciones.

Aun así, la idea central — simplificar las conexiones entre IA y herramientas — sigue siendo poderosa y está ganando tracción.

Por qué MCP es importante para los desarrolladores

- IA más capaz: Los modelos pueden obtener datos en tiempo real de forma segura, llamar a APIs reales y tomar acciones, no solo predecir texto.

- Tiempo de ingeniería reducido: No más invención de nuevas integraciones personalizadas para cada proyecto.

- Innovación más rápida: Construye aplicaciones de IA que hagan trabajo real sin luchar con código de pegamento y puntos finales rotos.

MCP está en sus inicios, pero apunta hacia un futuro donde los agentes de IA pueden trabajar de manera confiable en muchos sistemas — no mediante la combinación improvisada de APIs, sino siguiendo un estándar claro.

Conclusión

El Protocolo de Contexto de Modelo (MCP) proporciona a los desarrolladores un lenguaje común para conectar modelos y herramientas. Elimina las soluciones improvisadas de la integración de IA y sienta las bases para construir aplicaciones más ricas y poderosas. Si te tomas en serio trabajar con sistemas de IA, entender MCP ya no es opcional — es fundamental.

Preguntas frecuentes

No. Aunque Anthropic creó MCP, es un protocolo abierto. Cualquier LLM o sistema de IA puede implementarlo.

No necesariamente. Ya existen muchos servidores MCP de código abierto para servicios comunes como Postgres, GitHub y Slack.

No. MCP complementa las APIs creando una forma estándar para que los modelos de IA interactúen con ellas más fácilmente, no las reemplaza.